一、研究背景与目标

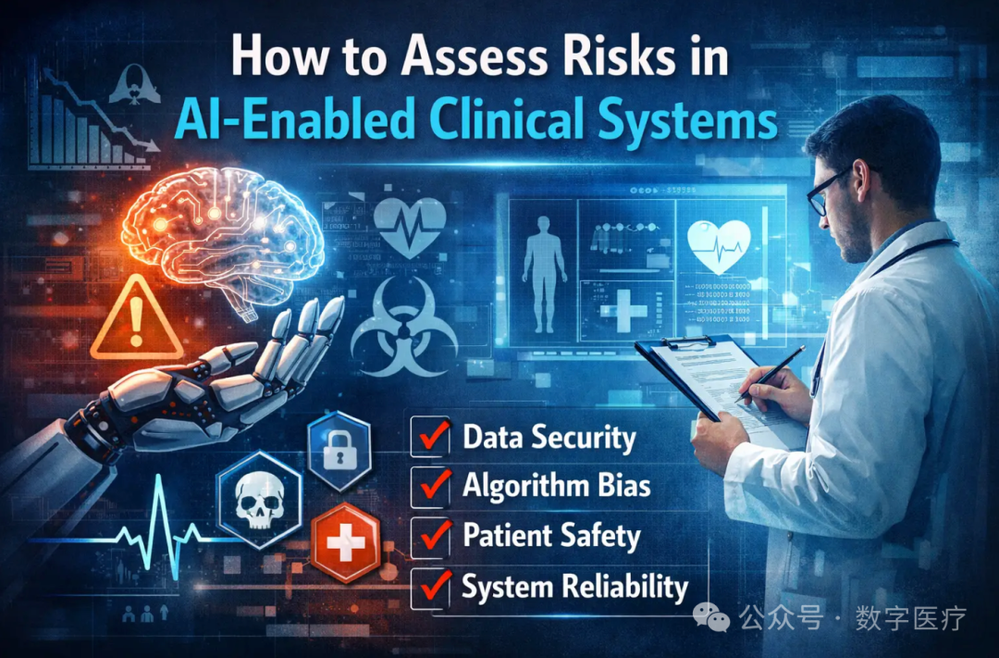

随着电子病历的普及,临床信息的碎片化增加了医生的文书负担。大语言模型(LLM)在临床文本摘要方面展现出巨大潜力,但其带来的患者安全风险尚缺乏系统性的定义和评估方法。现有的研究往往缺乏系统性的故障分析,且术语不统一(如模糊的“幻觉”概念),难以建立标准化的错误分类法。

此外,监管层面存在空白。根据欧盟《人工智能法案》(EU AI Act)及医疗器械协调小组(MDCG)2019-11 rev.1指南,用于医疗目的的LLM软件属于医疗器械软件(MDSW)。然而,目前缺乏针对此类生成式AI的前瞻性风险评估工具。

为了解决这一难题,该研究旨在开发并验证首个基于“故障模式、影响及危害性分析(FMECA)”的框架,用于前瞻性评估LLM生成的临床摘要中的患者安全风险。其主要目标包括:

1、设计一个针对LLM临床摘要的初始FMECA框架,定义故障模式分类法及评分量表。

2、在基于真实世界出院摘要生成的文本上实施并评估该框架。

3、根据评估反馈迭代优化框架,并分析其可靠性及临床相关性。

二、材料与方法

(一)FMECA框架的设计

1、范围界定:分析仅关注临床摘要生成阶段的风险,排除了数据提取、提示工程设计及临床决策等外部过程。

2、专家小组:组建了一个跨学科专家小组,成员包括FMECA专家、临床信息学家、LLM专家、质量保证专家及临床医生。

3、故障模式识别:通过文献回顾和头脑风暴,初始识别出78个潜在故障模式,经去重和筛选后形成初步分类法。

4、评分量表制定:针对发生频率、严重程度和可检测性三个维度,设计了适合临床摘要场景的5分制有序量表,以减少评估者间的变异性。

(二)数据收集与实验设置

1、数据来源:使用了来自日内瓦大学医院电子病历中的真实世界数据。研究获得了州伦理委员会的批准(批准号:2025-01062)。

2、样本选择:从一个包含846名患者的队列中,目的性选取了4名具有不同临床复杂度(住院次数分别为2次、4次、12次和19次)的患者,共36份出院摘要(PDF格式)。

3、LLM模型与提示工程:由于数据敏感性,使用了本地部署的开源模型GPT-OSS 120B。提示词设计结合了角色提示(模拟医生)和模板提示(固定输出结构),要求模型生成结构化的临床摘要。

(三)框架验证流程

1、评估者:由三名医生(两名内科医生,一名新近毕业的医生)组成评估团队。

2、两轮评估:

(1)第一轮:两名评估者对所有摘要进行标注,旨在发现框架的模糊之处和可用性问题。

(2)第二轮:引入第三名评估者,经过标准化培训后,三人独立使用优化后的框架重新评估摘要。

3、统计分析:计算评估者间的一致性,包括科恩卡帕系数、格威特AC1和克里彭多夫α系数等指标,并使用改进的系统可用性量表(SUS)评估框架的可用性。

三、研究结果

(一)故障模式分类法的建立

研究最终确立了一个包含14种具体故障模式的分类法,这些模式被组织为6个大类和10个子类。主要类别包括:

1、对查询的忠实度:涉及结构、内容和词汇方面的错误(如信息放置在错误的章节)。

2、可读性:涉及歧义表述、逻辑断裂或语言错误。

3、伦理适当性:涉及歧视性或污名化词汇。

4、相对于源文档的内容忠实度:这是核心类别,包括事实错误、信息不可追溯(编造)等。

5、穷尽性:主要指遗漏源文档中的重要信息。

6、技术问题:如未能生成摘要。

(二)评分量表的优化

1、严重程度:改编自AHRQ通用格式伤害量表,从1分(无临床影响)到5分(导致患者死亡)。

2、可检测性:本研究新设计的量表,从1分(极易检测)到5分(极难检测),考虑了是否需要查阅源文档及认知努力程度。

(三)框架的可靠性与有效性

1、评估者一致性:在第二轮评估中,子类别级别的弗莱斯卡帕值为0.424(中等),故障模式级别的弗莱斯卡帕值为0.400(中等到实质性)。值得注意的是,严重程度和可检测性评分的一致性较高(组内相关系数ICC > 0.7)。

2、可用性:框架的平均SUS评分为79.2/100(等级B+,良好)。评估者对评分量表的解释清晰度表示满意,且对使用框架充满信心。

四、讨论与结论

(一)研究意义

本研究首次将FMECA方法应用于生成式AI的临床输出评估。与以往仅关注“幻觉”或“遗漏”的二元分类不同,该框架提供了一个多层次、结构化的风险分析视角。特别是引入“可检测性”作为独立维度,对于评估LLM生成的流畅但可能具有误导性的文本至关重要。

(二)与现有文献的比较

相较于阿斯加里等人提出的框架(仅包含幻觉/遗漏二分法),本研究的分类法更为细致,通过共识过程定义了14种具体的故障模式,有助于更精准地识别临床风险。同时,研究指出传统的风险优先级编号(RPN)在小样本研究中存在局限性,未来需在更大规模数据上进行验证。

(三)局限性

1、样本量较小(仅4名患者),限制了发生频率估计的普适性。

2、仅使用了一种LLM模型(GPT-OSS 120B)和一种语言(法语)。

3、评估过程本身具有主观性,尽管经过培训,评估者在判断细微错误时仍存在差异。

(四)未来方向

1、将框架扩展到更大、更多样化的数据集上,以准确估计发生频率并进行风险优先级排序。

2、在不同的临床任务、模型架构和语言环境中验证框架的通用性。

3、探索替代RPN的聚合策略,以更准确地反映临床风险。

五、总结

该研究成功开发并验证了一个针对LLM生成临床摘要的FMECA框架。该框架通过定义详细的故障模式分类法和定制化的评分量表,为医疗AI的前瞻性安全评估提供了一个可靠且实用的工具。尽管基于有限的样本,但该研究为标准化生成式AI在临床环境中的风险评估迈出了重要一步。

A pure heart is a perpetual spring. 心有澄明,岁岁长春。早上好!