这篇文章提出了一种利用多模态大语言模型(MLLM)准确且可解释地预测胎儿扫描时胎龄的新方法。胎龄是评估胎儿发育和健康状况的关键指标,准确预测胎龄对临床决策至关重要。虽然深度学习模型在从脑部MRI预测胎龄方面取得了较高的准确性,但其“黑盒”特性限制了其在临床决策支持中的透明性和可解释性。该文旨在解决准确性和可解释性之间的双重挑战。

本文的主要贡献在于:首先,它采用了一种参数高效的微调策略,利用指令微调和低秩自适应技术对 Qwen2.5-VL-7B 模型进行微调,使其能够准确预测胎龄并生成与临床相关的解释。其次,本文提出了一种指令微调策略,将训练目标和推理目标解耦。在训练过程中,模型专注于准确预测胎龄数值;在推理过程中,通过不同的提示,模型能够根据从MRI衍生的图像中提取的发育特征生成可解释的临床相关解释。最后,本文通过实验和临床医生用户研究验证了该方法的有效性,证明了该方法在胎龄预测方面达到了接近最先进的水平,同时能够生成基于发育特征的可解释输出。

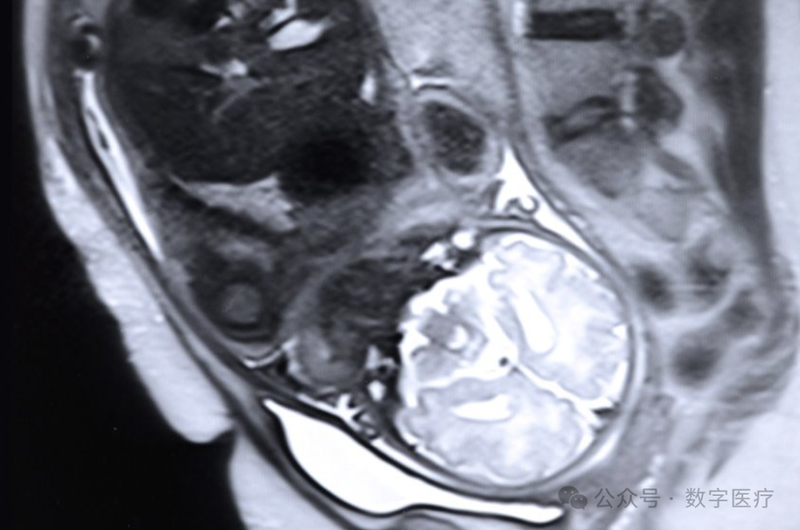

该研究使用了来自“发育人类连接组计划”的胎儿脑部MRI扫描数据。数据集包含476例胎儿扫描数据,涵盖了27至45周的胎龄,其中包括早产儿和足月健康对照组。对于每位受试者,研究人员使用了从胎儿MRI扫描中提取的四种二维皮质表面投影图作为模型输入。这四种模态分别代表皮质厚度、皮质曲率、皮质髓鞘化程度和沟壑深度,这些指标都反映了大脑发育的成熟程度。

模型采用Qwen2.5-VL-7B-Instruct作为基础模型,这是一个强大的多模态大型语言模型,具有强大的视觉和语言能力。为了提高训练效率并避免灾难性遗忘,研究人员采用了低秩自适应技术进行参数高效微调。低秩自适应技术通过冻结预训练模型权重,并在转换模型架构的特定层中注入可训练的低秩分解矩阵来实现参数高效微调,从而显著减少了可训练参数的数量。

本文中一个关键的创新点在于训练和推理阶段使用了不同的提示词。训练阶段的提示词直接要求模型预测胎龄的数值,模型的损失函数只针对数值预测结果进行计算,这使得模型能够高效地学习回归任务。推理阶段的提示词则更加复杂,要求模型不仅要预测胎龄数值,还要提供相应的解释。由于基础模型Qwen2.5-VL具有强大的指令遵循能力,微调后的模型能够在推理阶段根据视觉特征生成与临床相关的解释,而无需在训练阶段学习这些解释。

实验结果表明,微调后的模型在胎龄预测方面取得了较低的“平均绝对误差”,其95%置信区间为0.78至1.52周。蒙特卡洛自举法分析进一步证实了模型的鲁棒性。与其他通用型多模态大语言模型模型相比,该方法的预测精度显著提高,这突显了针对特定任务进行模型设计和训练策略的重要性。虽然在点估计平均绝对误差上略低于某些特定领域的模型,但置信区间下限接近这些模型的性能,表明该模型具有很强的能力,但对测试数据的分布较为敏感。

为了评估模型的临床实用性和解释的可信度,研究人员进行了一项用户研究,邀请了来自放射科、内科和急诊科的临床医生参与。结果表明,临床医生对模型的预测结果和解释的评价很高,认为预测误差在临床可接受范围内,解释具有可理解性和实用性,并且没有出现明显的幻觉现象。

文章最后讨论了该方法的局限性,例如使用二维投影图可能会导致信息损失,以及生成的解释需要进一步的临床验证。未来研究可以将文本特征(例如病史、出生报告等)纳入模型输入,或扩展模型以处理视觉和临床数据的时序序列,以提高预测精度和解释的质量。

总而言之,这项研究提供了一个构建可解释医学人工智能系统的强大框架。通过结合多模态大语言模型的参数高效微调和策略性提示工程,该研究创建了一个能够准确预测扫描时胎龄并解释其推理过程的模型,这为构建下一代值得信赖且可交互的临床医学人工智能工具带来了巨大的希望。

如需要《基于多模态大语言模型的准确且可解释的胎龄预测》(英文,15页),请在本微信公众号中赞赏(点喜欢或稀罕作者后按本公众号设定打赏)后,发来email地址索取。

Whisper your happiness softly, so as not to disturb others' sorrow; hide your sadness quietly, so as not to disrupt others' joy. 幸福的时候小声点,不要惊扰到别人的悲伤;悲伤的时候躲起来,不要打扰到他人的幸福。早上好!