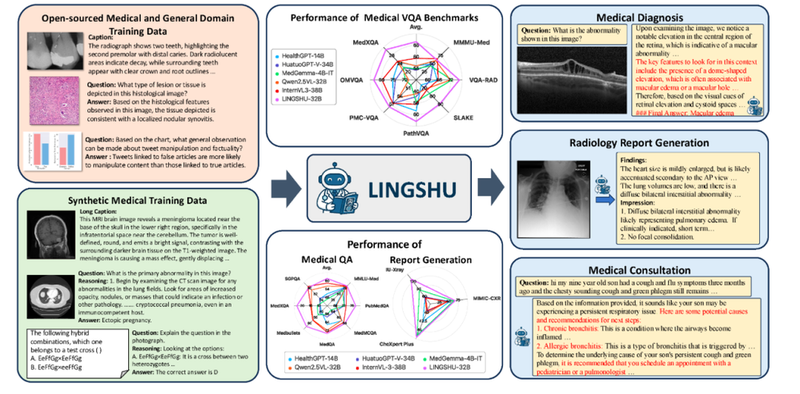

为了解决这三大痛点,阿里巴巴达摩院的研究人员开源了统一多模态医学大模型——灵枢。

团队表示,在多项医学任务上达到SOTA(最佳水平),特别是在医学VQA任务上,32B版本平均超过第二名7.2个百分点。

此外,灵枢-32B在多数多模态问答和报告生成任务上优于GPT-4.1和Claude Sonnet 4。

针对知识和数据覆盖不足的问题,团队构建了层次化的数据源体系,包括多模态医疗数据、单模态医疗数据和通用领域数据。

不仅整合了开源医学数据集(如MIMIC-CXR、PMC-VQA等),还通过GPT-4o合成长文本描述、OCR问答和思维链推理数据。此外,团队还构建了一个严格的数据清洗流程,为大模型提供了高质量数据。

多层数据下,让大模型不仅掌握了医学领域的专业知识,同时拥有通用的理解以及泛化能力。

因此,灵枢能够识别超过12种医学成像,包括CT、病理、MRI、PET等多个数据模式。

灵枢支持多种医学成像数据

而在模型架构上,灵枢基于Qwen2.5-VL架构,使用了医疗浅层对齐、医疗深层对齐、医疗指令调优和医疗导向四阶段强化训练方法,实现医疗知识的分层嵌入与能力迭代提升。

最终,训练后的灵枢能够处理多种医学成像模态的视觉问答任务,分析图像中的异常并提供诊断建议,并生成详细的诊断报告。

在医学问答方面,模型能够结合患者病史、检查数据,提供有建设性的治疗建议并解释推理逻辑。此外,灵枢还可以用于公共卫生、医学教育、患者沟通等领域。

简单而言,该研究为构建可信赖的医学AI模型提供了宝贵思路,其方法学创新将推动整个医学AI领域的发展。

团队表示,未来工作应继续聚焦于构建更高质量、更多样化的医学数据集,同时提升模型的临床适用性和安全性,最终实现AI辅助医疗的广泛应用。